Google Tanggapi Laporan Mesin Pencarian AI yang Berhalusinasi, Sarankan Menambahkan Lem ke Pizza

Seorang juru bicara Google menanggapi laporan yang menyebut bahwa fitur mesin pencarian AI berhalusinasi dan membuat publisher kehilangan pengunjung

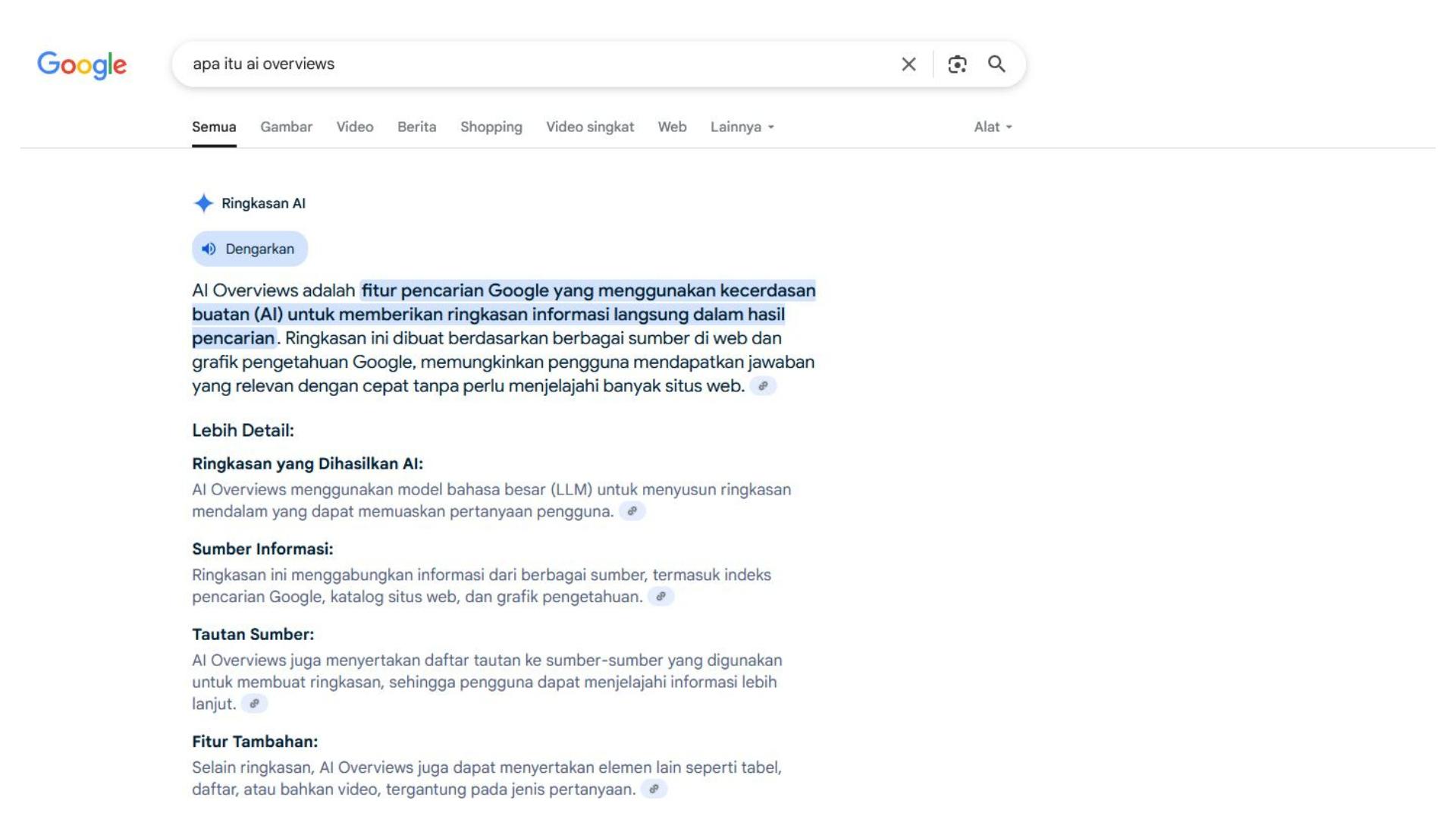

TRIBUNNEWS.COM – Google menanggapi laporan dari The Times of London yang menyebut bahwa fitur AI Overviews atau Ringkasan AI berhalusinasi dan membuat publisher kehilangan traffic pengunjung.

Google memperkenalkan AI Overviews, yang dirancang untuk memberikan jawaban cepat atas permintaan pencarian pengguna, tahun lalu.

Namun The Times of London menyebut AI Overviews seringkali memberikan saran yang keliru, bahkan berbahaya, dalam ringkasan pencariannya.

Dalam salah satu kasus, AI Overviews menyarankan untuk menambahkan lem pada saus pizza agar kejunya lebih menempel.

Kasus ini viral tahun lalu.

Seorang pengguna melakukan pencarian di Google dengan kata kunci "keju tidak menempel di pizza."

AI Overviews kemudian menjawab:

"Keju bisa tergeser dari pizza karena beberapa alasan, termasuk terlalu banyak saus, terlalu banyak keju atau saus yang terlalu kental."

"Ini beberapa hal yang bisa kamu coba:

- Campur dalam saus: Mencampur keju ke dalam saus dapat membantu menambah kelembaban pada keju dan mengeringkan saus.

Kamu juga bisa menambahkan sekitar 1/8 cup lem non-toxic ke dalam saus untuk membuatnya lebih melekat."

Baca juga: AI DeepSeek Prediksi Laga Timnas Indonesia Vs China di GBK, Hasilnya Mengejutkan

Saat itu, Liz Reid, kepala bagian pencarian Google, mengakui ketidakakuratan yang dihasilkan oleh Google AI.

Mengutip financialexpress.com, ia mengatakan, "Beberapa AI Overviews yang aneh, tidak akurat, atau tidak membantu memang muncul."

"Dan meskipun ini umumnya untuk kueri yang tidak biasa dilakukan orang, kasus ini menyoroti beberapa area spesifik yang perlu kami tingkatkan."

Halusinasi semacam ini, sebagaimana disebut oleh para ilmuwan komputer, diperburuk oleh kecenderungan alat AI tersebut untuk mengurangi visibilitas sumber-sumber informasi yang bereputasi baik, menurut The Times of London.

Bukannya mengarahkan pengguna langsung ke situs web tertentu, AI Overviews merangkum informasi dari hasil pencarian dan menyajikan jawaban yang dihasilkan AI, lengkap dengan beberapa tautan pendukung.

Laurence O’Toole, pendiri firma analitik Authoritas, meneliti dampak tool ini dan menemukan bahwa rasio klik-tayang ke situs web penerbit menurun hingga 40 persen–60 persen saat AI Overviews muncul.

Seorang juru bicara Google menanggapi:

"Cerita ini menarik kesimpulan yang sangat tidak akurat dan menyesatkan tentang AI Overviews berdasarkan contoh dari lebih dari setahun yang lalu," kata juru bicara Google kepada The New York Post.

"Kami memiliki bukti langsung bahwa AI Overviews membuat pengalaman Penelusuran menjadi lebih baik, dan orang-orang lebih menyukai Penelusuran dengan AI Overviews."

"Kami memiliki standar kualitas yang sangat tinggi untuk semua fitur Penelusuran, dan sebagian besar Ringkasan AI akurat dan bermanfaat."

Meski menuai kekhawatiran publik, CEO Google Sundar Pichai membela AI Overviews dalam sebuah wawancara dengan The Verge.

Ia menyatakan bahwa fitur tersebut membantu pengguna menemukan sumber informasi yang lebih beragam.

“Selama setahun terakhir, kami melihat bahwa jangkauan topik yang bisa kami tangani terus bertambah. Kami secara jelas mengarahkan traffic ke lebih banyak sumber dan penerbit,” ujarnya.

Namun, Google tampaknya meremehkan tingkat halusinasi pada sistemnya sendiri.

Baca juga: Ilmuwan Komputer Amerika: AI Akan Sapu Bersih 98,8 Persen Populasi Manusia pada Tahun 2300

Saat seorang jurnalis mencari informasi di Google tentang seberapa sering AI-nya melakukan kesalahan, AI mengklaim tingkat halusinasi hanya berkisar antara 0,7 persen hingga 1,3%.

Padahal, data dari platform pemantauan AI Hugging Face menunjukkan bahwa tingkat sebenarnya untuk model Gemini terbaru mencapai 1,8%.

Model AI Google juga tampaknya memberikan pembelaan otomatis terhadap tindakannya sendiri.

Ketika ditanya apakah AI “mencuri” karya seni, sistem tersebut menjawab bahwa AI tidak mencuri karya seni dalam pengertian tradisional.

Saat ditanya apakah manusia harus takut pada AI, alat itu menjelaskan beberapa kekhawatiran umum sebelum menyimpulkan bahwa rasa takut tersebut kemungkinan berlebihan.

Sejumlah ahli khawatir bahwa seiring semakin kompleksnya sistem AI generatif, sistem-sistem ini juga menjadi semakin rentan terhadap kesalahan—bahkan para pembuatnya pun tidak selalu dapat menjelaskan penyebabnya.

Kekhawatiran terkait halusinasi AI tidak hanya menimpa Google.

OpenAI baru-baru ini mengakui bahwa dua model terbarunya, yang dikenal sebagai o3 dan o4-mini, menunjukkan kecenderungan halusinasi yang lebih tinggi dibanding versi sebelumnya.

Dalam pengujian internal, terungkap bahwa model terbaru o3 dan o4-mini menjadi korban halusinasi yang lebih parah dibandingkan model sebelumnya.

Dalam statistik yang muncul sebagai yang terburuk dari sebelumnya, tingkat halusinasi o3 adalah 33% ketika pertanyaan terkait dengan orang sungguhan dan fakta tersedia.

o4-mini memberikan gambaran yang lebih buruk dengan 48% halusinasi, yang berarti bahwa model tersebut tidak hanya memberikan informasi palsu tetapi juga data imajiner.

(Tribunnews.com, Tiara Shelavie)

Isi komentar sepenuhnya adalah tanggung jawab pengguna dan diatur dalam UU ITE.